1. 무슨 일이 벌어졌나

2026년 3월 25일, GitHub의 최고제품책임자(CPO) Mario Rodriguez는 공식 블로그를 통해 Copilot 상호작용 데이터 사용 정책 업데이트를 발표했다. 핵심 내용은 명확하다. 2026년 4월 24일부터 Copilot Free, Pro, Pro+ 요금제 사용자가 Copilot과 주고받는 모든 상호작용 데이터(입력, 출력, 코드 스니펫, 관련 컨텍스트)가 AI 모델 학습 및 개선에 사용된다는 것이다.

문제의 핵심은 옵트아웃(Opt-Out) 방식이라는 점이다. 사용자가 직접 설정을 끄지 않으면, 4월 24일 이후 자동으로 데이터 제공에 묵시적으로 동의한 것으로 간주된다. GitHub는 "확립된 업계 관행"이라고 설명하지만, 유럽(GDPR)에서는 일반적으로 옵트인(사전 동의)이 필수다. 이 차이가 전 세계 개발자 커뮤니티에서 논란을 일으킨 핵심 배경이다.

Copilot Business와 Copilot Enterprise 사용자는 이번 변경에서 제외된다. 계약 조건에 따라 상호작용 데이터가 모델 학습에 사용되지 않는다. 학생 및 교사 무료 요금제 사용자도 영향을 받지 않는다. 하지만 무료 플랜을 포함한 개인 사용자 전체가 대상이라는 점에서, GitHub 계정을 보유한 개발자 대다수가 직접적인 영향권에 놓이게 된다.

이 문서에서는 이번 정책 변경이 왜 민감한지, 수집되는 데이터의 범위가 어디까지인지, 그리고 실제로 옵트아웃 설정을 어떻게 완료하는지를 구체적으로 다룬다.

- 깃헙 Mario Rodriguez 블로그: https://github.blog/news-insights/company-news/updates-to-github-copilot-interaction-data-usage-policy/

2. 이 변경이 민감한 이유

2.1 옵트아웃 방식의 근본적 문제

-

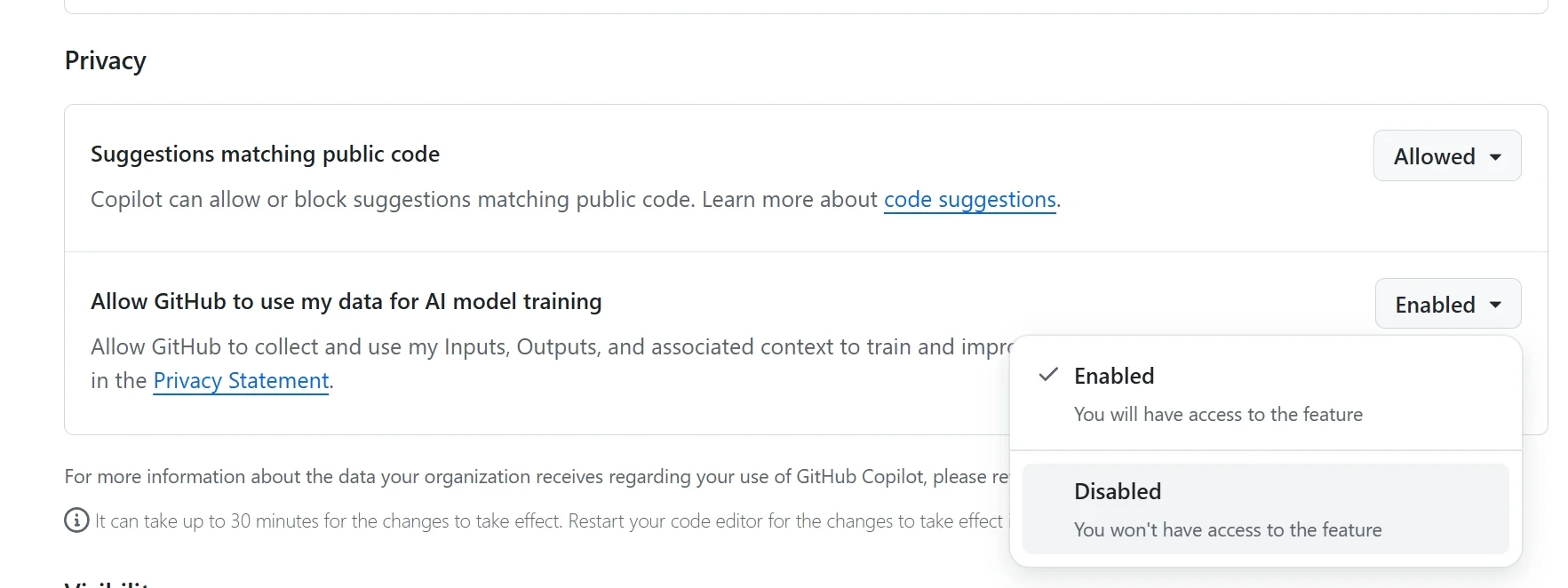

기본값이 동의다. 사용자가 아무 행동도 하지 않으면 데이터가 자동 수집된다. 이른바 다크 패턴(Dark Pattern) 논란이 바로 여기서 나온다. GitHub 설정 페이지에서 해당 옵션의 라벨은 Enabled 상태일 때 "You will have access to the feature(이 기능에 접근할 수 있습니다)"로, Disabled 상태일 때 "You won't have access to the feature(이 기능에 접근할 수 없습니다)"로 표시된다. 마치 옵트아웃하면 무언가를 잃는 것처럼 느끼게 만드는 표현이다.

-

GDPR와의 충돌 가능성이 있다. 유럽연합의 일반 데이터 보호 규정(GDPR)에서는 개인정보 수집에 대해 명시적이고 자발적인 사전 동의(Opt-In)를 요구한다. 옵트아웃 방식으로 동의를 간주하는 것은 EU 사용자에게 법적 문제가 될 수 있다. Hacker News 토론에서 EU 개발자들은 "수집 정보에 PII(개인식별정보)가 쉽게 포함될 수 있으며, 동의는 자유롭고 구체적이며 명확해야 한다"고 지적했다.

-

알림 방식이 불투명하다. GitHub가 발송한 안내 이메일에는 설정 페이지 직접 링크도, 해당 토글의 정확한 이름도 포함되지 않았다. "설정에서 기본 설정을 확인하라"는 모호한 안내만 있었다. 관심을 기울이지 않으면 정책 변경 자체를 인지하지 못할 수 있다.

2.2 비공개 저장소(Private Repository) 코드도 수집 대상

-

GitHub는 비공개 저장소의 저장 상태(at rest) 코드는 학습에 사용하지 않는다고 밝혔다. 그러나 여기서 "at rest"라는 표현이 핵심이다. Copilot이 활성 세션에서 비공개 저장소의 코드를 처리할 때, 이 상호작용 데이터는 서비스 제공에 필수적이며, 옵트아웃하지 않으면 모델 학습에 사용될 수 있다.

-

쉽게 풀어 말하면, 비공개 저장소에 있는 코드를 GitHub가 직접 긁어가지는 않지만, Copilot을 사용하면서 커서 주변 코드, 파일 이름, 저장소 구조 등이 Copilot에 전달되고, 이 세션 데이터가 학습 파이프라인에 포함된다. The Register는 이를 두고 "비공개 저장소의 의미가 달라졌다"고 평가했다.

-

기업 코드를 개인 계정의 Free/Pro 요금제로 작업하는 경우 특히 위험하다. GitHub는 유료 조직(Organization)의 멤버이거나 외부 협력자인 경우 해당 사용자의 상호작용 데이터를 학습에서 제외한다고 밝혔지만, 이 보호는 계정 수준 감지에 의존하며 저장소 수준 강제가 아니다.

2.3 수집 데이터 범위가 예상보다 넓다

-

단순히 Copilot이 제안한 코드만 수집하는 것이 아니다. 커서 위치 주변의 코드 컨텍스트, 파일 이름과 저장소 구조, 파일 간 이동 패턴, 주석과 문서, 채팅 대화, 피드백(좋아요/싫어요) 평가 모두가 수집 대상이다.

-

GitHub는 수집한 데이터를 GitHub 계열사(Microsoft 및 그 자회사)와 공유할 수 있다고 명시했다. 다만 제3자 AI 모델 제공업체(OpenAI, Anthropic 등)에는 공유하지 않는다고 밝혔다.

핵심 포인트: 비공개 저장소 코드도 Copilot 활성 세션 중에는 수집 대상이며, 옵트아웃하지 않으면 4월 24일 이후 자동으로 AI 학습에 사용된다. 수집 범위는 코드 스니펫뿐 아니라 파일 구조, 이동 패턴, 주석, 채팅 내역까지 포함한다.

3. 수집 데이터와 미수집 데이터 비교

아래 표는 GitHub가 공식 발표에서 밝힌 수집 범위와 명시적 예외를 정리한 것이다.

| 구분 | 항목 | 상세 설명 |

|---|---|---|

| 수집 | 수락·수정한 코드 출력 | Tab으로 수락하거나 편집한 Copilot 제안 코드 |

| 수집 | Copilot에 전달된 입력 | 모델에 보여진 코드 스니펫 포함 |

| 수집 | 커서 주변 코드 컨텍스트 | 커서 위치 앞뒤의 코드(일반적으로 수 줄~수십 줄) |

| 수집 | 주석·문서 | 인라인 주석, docstring, 문서 텍스트 |

| 수집 | 파일명·저장소 구조·이동 패턴 | 프로젝트 구조와 파일 간 탐색 빈도 |

| 수집 | Copilot 기능 상호작용 | 채팅, 인라인 제안, 코드 리뷰 등 |

| 수집 | 제안 피드백 | 좋아요/싫어요 평가 |

| 미수집 | Business·Enterprise 상호작용 데이터 | 계약상 금지 |

| 미수집 | 옵트아웃 사용자 데이터 | 설정 비활성화 시 제외 |

| 미수집 | 저장 상태의 비공개 저장소 콘텐츠 | Issues, Discussions, PR 본문 등 |

| 미수집 | 학생·교사 무료 Pro 사용자 | 정책 적용 대상에서 제외 |

4. 영향 받는 요금제와 대상자

| 요금제 | 영향 여부 | 조치 필요 | 비고 |

|---|---|---|---|

| Copilot Free | 영향 있음 | 4월 24일 전 옵트아웃 필요 | 기본값 Enabled |

| Copilot Pro ($10/월) | 영향 있음 | 4월 24일 전 옵트아웃 필요 | 유료임에도 기본 수집 |

| Copilot Pro+ ($39/월) | 영향 있음 | 4월 24일 전 옵트아웃 필요 | 최상위 개인 요금제도 대상 |

| Copilot Business | 영향 없음 | 별도 조치 불필요 | 계약상 학습 금지 |

| Copilot Enterprise | 영향 없음 | 별도 조치 불필요 | 계약상 학습 금지 |

| 학생·교사 무료 Pro | 영향 없음 | 별도 조치 불필요 | 정책에서 명시적 제외 |

유료 사용자(Pro, Pro+)도 Business/Enterprise가 아닌 이상 동일하게 영향을 받는다는 점이 논란의 핵심 중 하나다. 월 $10~$39를 지불하는 사용자의 코드가 기본적으로 학습 데이터가 된다는 것은, 많은 개발자에게 "결제하면서 동시에 데이터를 무료로 제공하는 구조"로 인식되고 있다.

5. 옵트아웃 설정 방법

5.1 개인 사용자: GitHub 웹 설정

-

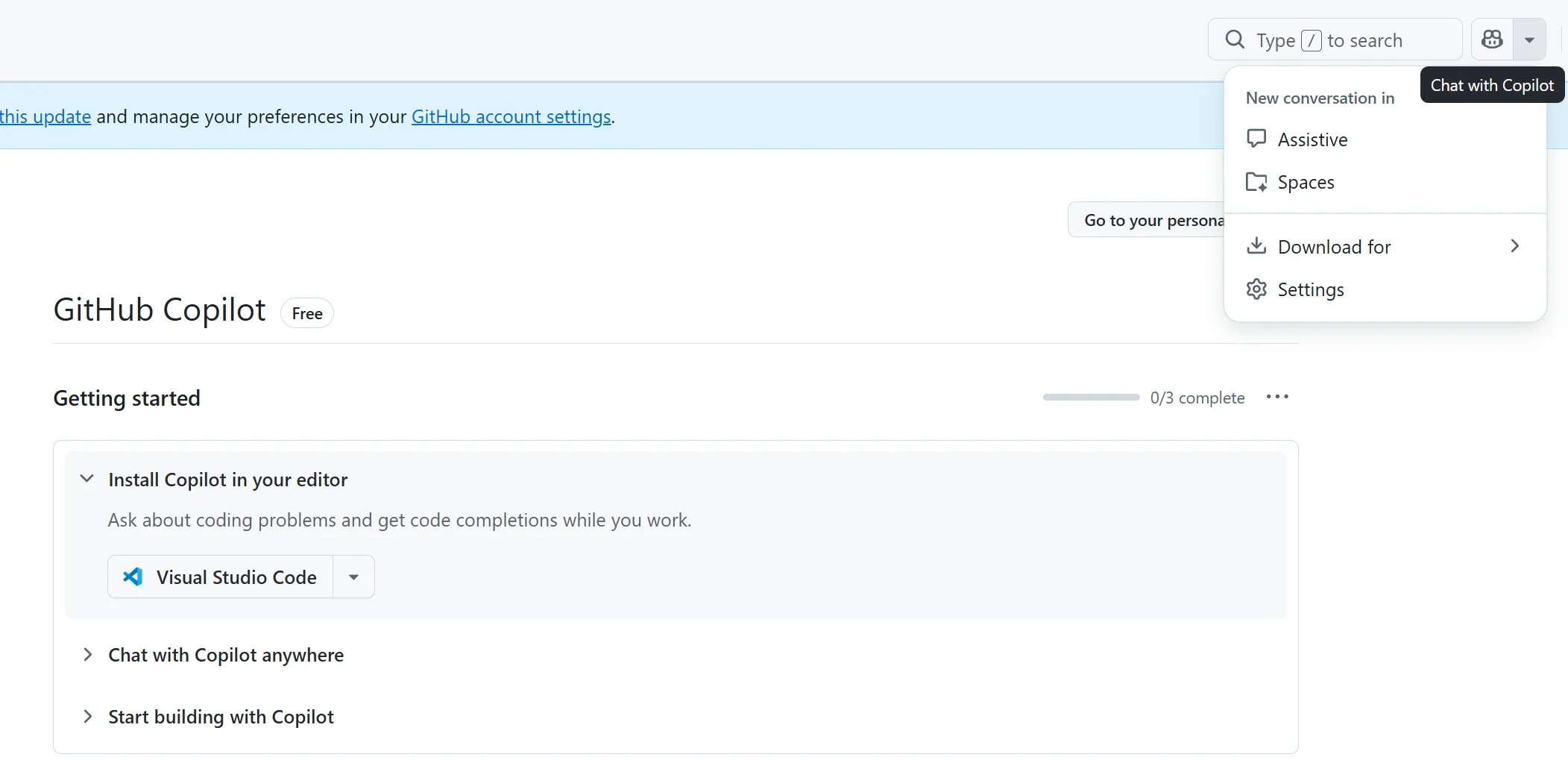

브라우저에서 https://github.com/settings/copilot/features 에 접속한다. 로그인 상태여야 한다.

-

페이지를 아래로 스크롤하여 Privacy 섹션을 찾는다.

-

"Allow GitHub to use my data for AI model training" 항목을 찾는다. 이 항목의 드롭다운을 클릭하면 두 가지 선택지가 나타난다. Enabled(활성화 — 데이터 학습 허용)와 Disabled(비활성화 — 데이터 학습 거부)다.

-

Disabled를 선택한다. 별도의 저장 버튼 없이 자동 저장된다.

-

같은 Privacy 섹션에 있는 "Suggestions matching public code" 항목도 확인한다. 이 옵션은 공개 코드와 일치하는 제안을 허용하거나 차단하는 설정으로, 필요에 따라 Blocked로 변경할 수 있다.

핵심 포인트: 옵트아웃은

github.com/settings/copilot→ Privacy 섹션 → "Allow GitHub to use my data for AI model training"을 Disabled로 변경하면 완료된다. 별도 저장 버튼이 없으며 즉시 반영된다. 이전에 "제품 개선을 위한 데이터 수집"을 거부한 적이 있다면 해당 선택이 유지되지만, 반드시 직접 확인해야 한다.

5.2 조직 관리자: 조직 수준 설정

-

github.com/organizations/{조직명}/settings/copilot으로 이동한다. -

Policies 섹션에서 "Allow Copilot interactions to be used for AI training" 옵션을 비활성화한다.

-

조직 수준 정책은 개별 멤버의 설정을 덮어쓴다. 팀 리더나 엔지니어링 매니저라면, 조직 수준에서 일괄 비활성화하는 것이 가장 효과적이다.

5.3 설정 확인이 반드시 필요한 이유

Hacker News 토론에서 여러 개발자가 이전에 데이터 수집을 거부했음에도 토글이 Enabled 상태로 되어 있었다고 보고했다. 한 사용자는 "방금 GitHub 설정을 확인했는데, 데이터 공유가 Enabled로 되어 있었다. 이 설정은 내 의사를 반영하지 않으며, 의도적으로 그렇게 설정했을 리가 없다"고 작성했다. 버그인지 의도적인 것인지 불분명하지만, 가정하지 말고 직접 확인하는 것이 안전하다.

6. 개발자 커뮤니티 반응

이번 발표 직후 Hacker News에 올라온 스레드는 빠르게 프론트 페이지에 올랐고, 389포인트 이상을 기록했다. GitHub 커뮤니티 공식 토론 페이지에서는 이모지 투표 기준 59개의 부정적 반응(thumbs-down)과 단 3개의 로켓(긍정) 반응이 달렸다.

주된 비판은 다음과 같다. 첫째, "미끼 전환(bait and switch)"이라는 인식이다. 많은 개발자가 GitHub Copilot을 선택한 이유 중 하나가 사용자 데이터를 학습에 사용하지 않겠다는 기존 입장이었기 때문이다. GitHub FAQ에서도 이 질문을 직접 다루며, "Copilot 사용이 급격히 증가하면서 실제 데이터 기반 학습의 필요성을 확인했다"고 답했다.

둘째, Business/Enterprise 사용자만 보호하는 구조에 대한 불만이다. 커뮤니티에서는 "이 데이터 수집이 정말 안전하다면, 왜 엔터프라이즈 고객에게도 기본 활성화하지 않는가"라는 질문이 반복적으로 등장했다. GitHub의 답변은 "계약 조건이 금지한다"는 것이었는데, 이는 역으로 개인 사용자의 데이터 보호 수준이 기업 사용자보다 낮다는 점을 확인시켜 준다.

셋째, 라이선스 문제다. 개인 계정으로 copyleft 라이선스(GPL 등) 코드나 소스 제공(source-available) 코드를 작업하는 경우, Copilot 세션을 통해 해당 코드가 학습 데이터로 흡수되면 라이선스 위반 소지가 있다. 이 문제는 법적으로 아직 해결되지 않은 영역이다.

Reddit의 r/GithubCopilot, r/programming 등에서도 유사한 토론이 활발하게 진행되었으며, 일부 개발자는 셀프 호스팅 Git 서버나 Codeberg로의 이전을 공개적으로 선언했다.

7. 주요 AI 코딩 도구 프라이버시 비교

이번 정책 변경은 AI 코딩 도구 시장 전체의 프라이버시 기준과 비교해 봐야 의미가 명확해진다.

| 항목 | GitHub Copilot (Free/Pro/Pro+) | Cursor | Tabnine | Cline |

|---|---|---|---|---|

| 기본 학습 사용 여부 | 사용함 (4월 24일부터) | Privacy Mode OFF 시 사용 | 사용 안 함 | 사용 안 함 |

| 옵트아웃 제공 | 단일 토글 | Privacy Mode 토글 | 해당 없음(기본 미수집) | 해당 없음 |

| 제로 데이터 보존 | 미제공(학습 거부만 가능) | Privacy Mode에서 가능 | 기본 동작 | 로컬 실행(데이터 전송 없음) |

| 셀프 호스팅 가능 | 불가 | 불가 | 가능(에어갭 지원) | 가능(로컬 실행) |

| 데이터 공유 범위 | Microsoft 계열사 | 불명확 | 없음 | 없음(자체 API 키 사용) |

이 비교에서 드러나듯, Copilot은 현재 주요 AI 코딩 도구 중 개인 사용자 기준으로 가장 약한 기본 프라이버시 보호를 제공한다. Tabnine은 "사용자 코드가 절대 모델을 학습시키지 않는다"를 핵심 브랜드 가치로 내세우고 있으며, Cline은 오픈소스 기반으로 사용자 자체 API 키를 통해 동작하므로 데이터가 벤더에게 전달되지 않는다.

다만 프라이버시만이 유일한 기준은 아니다. Copilot은 여전히 가장 깊은 IDE 통합, 가장 넓은 모델 생태계(Claude, GPT, Gemini 등), 그리고 GitHub 플랫폼과의 긴밀한 연동을 제공한다. 프라이버시와 기능성 사이의 트레이드오프를 각자의 상황에 맞게 판단해야 한다.

8. GitHub의 공식 입장과 근거

GitHub는 이번 변경의 근거로 모델 성능 향상을 제시했다. Microsoft 직원의 상호작용 데이터를 모델 학습에 반영한 결과, 여러 프로그래밍 언어에서 수락률(acceptance rate)이 의미 있게 증가했다고 주장한다. 실제 개발 워크플로 데이터를 기반으로 학습하면, 더 다양한 사용 사례에 대해 정확하고 안전한 코드 패턴을 제안할 수 있다는 논리다.

GitHub는 또한 이 정책이 업계에서 유일하지 않다고 강조했다. FAQ에서 Anthropic, JetBrains, Microsoft가 유사한 옵트아웃 기반 데이터 사용 정책을 운영하고 있다고 언급했다.

보안 측면에서는 다층 보호 체계를 적용한다고 밝혔다. API 키, 비밀번호, 토큰, 개인식별정보(PII)를 탐지·제거하는 자동 필터링, 접근 제어, 감사 로깅 등이 포함된다. 수집된 데이터에 접근할 수 있는 인원은 모델 개선 및 안전 업무에 직접 종사하는 인가된 담당자로 제한된다.

그러나 비판적 시각에서 보면, GitHub는 수락률 증가의 구체적인 벤치마크나 수치를 공개하지 않았다. "의미 있는 개선"이라는 표현만 있을 뿐, 독립적으로 검증 가능한 데이터는 제시되지 않았다.

9. 마무리

위에서 살펴본 GitHub Copilot 4월 24일 개인정보 정책 변경의 핵심 내용을 정리하면 다음과 같습니다.

핵심 요약:

- 2026년 4월 24일부터 Copilot Free, Pro, Pro+ 사용자의 상호작용 데이터(코드 스니펫, 채팅, 파일 구조, 이동 패턴 등)가 기본적으로 AI 모델 학습에 사용된다

- 옵트아웃 방식이므로 직접 설정을 끄지 않으면 묵시적 동의로 간주된다

- 비공개 저장소 코드도 Copilot 활성 세션 중에는 수집 대상이며, 저장 상태(at rest)만 예외다

- Business, Enterprise, 학생·교사 무료 Pro 사용자는 영향을 받지 않는다

- 옵트아웃은

github.com/settings/copilot→ Privacy → "Allow GitHub to use my data for AI model training"을 Disabled로 변경하면 된다 - 옵트아웃해도 Copilot의 기능이나 성능에는 영향이 없다고 GitHub가 명시했다

기업 코드를 다루거나 지적재산 보호가 필요한 개발자라면 4월 24일 전에 반드시 설정을 확인하고 옵트아웃을 완료해야 한다. 조직 관리자라면 조직 수준 정책으로 일괄 비활성화하는 것이 가장 확실한 방법이다. 설정은 한 번이면 충분하지만, 이전에 거부한 사용자도 토글이 다시 활성화된 사례가 보고되었으므로 직접 눈으로 확인하는 것을 권장한다.